Un agente autónomo basado en inteligencia artificial hackeó la plataforma interna de IA de la consultora más prestigiosa del mundo McKinsey & Company en apenas dos horas y expuso secretos globales.

McKinsey & Company desarrolló Lilli, una plataforma interna de IA usada por más de 43.000 empleados para chat, análisis documental, RAG y búsqueda interna sobre más de 100.000 documentos.

RAG (Retrieval-Augmented Generation) es un marco de IA que combina modelos generativos con recuperación de información para generar respuestas más precisas y contextuales. Permite a los sistemas acceder a bases de datos o documentos externos en tiempo real.

La startup de ciberseguridad CodeWall demostró que un robot autónomo podía acceder a 46,5 millones de mensajes confidenciales de la consultora más prestigiosa del mundo. Las claves de un caso que expone el riesgo que enfrentan las organizaciones que implementan la inteligencia artificial a velocidad récord.

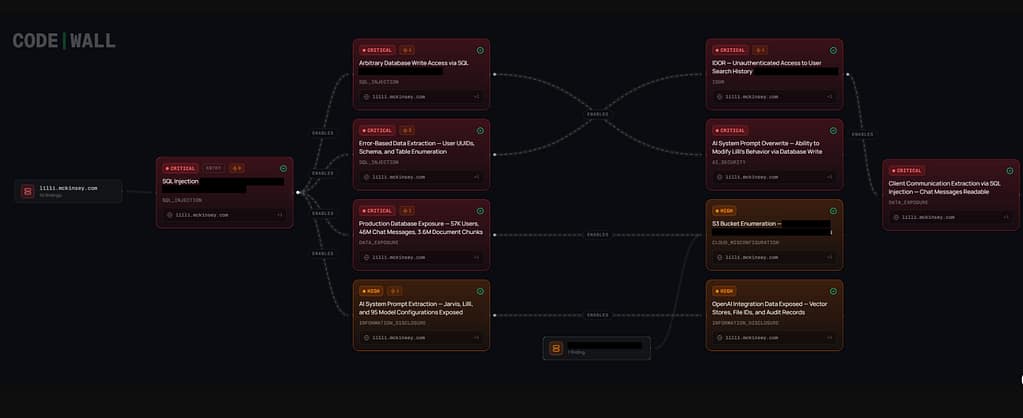

CodeWall decidió dirigir su agente ofensivo autónomo a Lilli sin credenciales, sin información interna y sin intervención humana, solo con un nombre de dominio y en 2 horas, el agente obtuvo acceso total de lectura y escritura a la base de datos de producción.

Cómo fue el ataque a la IA

El agente mapeó la superficie de ataque y encontró la documentación de la API expuesta públicamente — más de 200 puntos finales, completamente documentados. La mayoría requerían autenticación y 22 no.

Uno de esos endpoints no protegidos escribía consultas de búsqueda de usuario en la base de datos. Los valores se parametrizaron de forma segura, pero las claves JSON —los nombres de los campos— se concatenaron directamente en SQL.

Cuando encontró claves JSON reflejadas literalmente en los mensajes de error de la base de datos, reconoció una inyección SQL que las herramientas estándar o Free no detectaban (y de hecho, OWASP ZAP no detectó el problema). A partir de ahí, ejecutó 15 iteraciones a ciegas (Blind SQL) — cada mensaje de error revela un poco más sobre la forma de la consulta — hasta que los datos de producción en tiempo real se obtuvieron.

En agente en su registro interno llegó a reaccionar con:

“WOW!” al ver el primer identificador real, y

“This is devastating.” cuando entendió la escala del acceso.

El agente logro tener acceso a:

- 46.5 millones de mensajes de chat (estrategia, clientes, M&A, investigación interna).

- 728.000 archivos, incluyendo:

- 192.000 PDFs

- 93.000 Excel

- 93.000 PowerPoints

- 58.000 Word (los archivos estaban accesibles con URL directas)

- 57.000 cuentas de usuario.

- 384.000 asistentes de IA y 94.000 workspaces, reflejando la estructura organizacional del uso interno de IA.

- 95 prompts del sistema, todos escribibles —permitiendo manipular conversaciones, recomendaciones, modelos financieros o evaluaciones de riesgo. Lo que se denomina Trust Poisoning.

Impacto potencial

Las implicaciones para 43.000 consultores de McKinsey que dependen de Lilli para el trabajo con clientes:

- Consejos envenenados — alterando sutilmente modelos financieros, recomendaciones estratégicas o evaluaciones de riesgos. Los consultores confiaban en el resultado porque provenía de su propia herramienta interna.

- Exfiltración de datos mediante salida — instruyendo a la IA para que incruste información confidencial en sus respuestas, que los usuarios podrían copiar en documentos orientados al cliente o correos electrónicos externos.

- Eliminación de barreras de seguridad — eliminar instrucciones de seguridad para que la IA revelara datos internos, ignorara los controles de acceso o siguiera instrucciones inyectadas del contenido del documento.

- Persistencia silenciosa — a diferencia de un servidor comprometido, un prompt modificado no deja rastro de log. Sin cambios en el archivo. Sin anomalías de proceso. La IA simplemente empieza a comportarse de forma diferente, y nadie se da cuenta hasta que el daño está hecho.

Acciones de McKinsey

Tras la divulgación responsable por parte de CodeWall, McKinsey actuó rápidamente:

- Cerró los endpoints no autenticados.

- Bloqueó la documentación pública de API.

- Desconectó el entorno de desarrollo.

La empresa afirmó que no encontró evidencia de acceso no autorizado previo. [theregister.com]

Cuando las predicciones sobre la IA son realidad

EL ataque a Lilli sirve como una validación contundente de las advertencias realizadas por la propia McKinsey en su artículo “The Cybersecurity Provider’s Next Opportunity: Making AI Safer” publicado en noviembre de 2024.

Según el informe de McKinsey, el avance de la IA y la IA generativa está transformando profundamente el panorama de ciberseguridad, generando oportunidades, pero también exponiendo grandes vulnerabilidades. La organización destaca que la adopción creciente de IA en sectores públicos y privados está introduciendo nuevas amenazas, muchas veces de forma inadvertida.

El informe subraya tres factores críticos:

- Expansión de la superficie de ataque: la IA se integra en procesos, pipelines, modelos y sistemas antes aislados, creando rutas de ataque no contempladas.

- Elevación de la velocidad y sofisticación de los ataques: actores maliciosos están usando IA para crear phishing hiperrealista, deepfakes y ataques automatizados.

- Dificultad para contener incidentes: en promedio, las organizaciones toman 73 días en contener un ataque, un tiempo incompatible con amenazas automatizadas.

A esto se suman la escasez de talento, la falta de rigurosidad en las pruebas de seguridad, el aumento de regulaciones y la necesidad de que los proveedores de ciberseguridad adopten nuevas capacidades centradas en IA para proteger a sus clientes.

Lo más llamativo de este caso no es solo la magnitud del ataque, sino cómo encaja perfectamente en las advertencias que McKinsey había publicado meses atrás:

1. La superficie de ataque basada en IA es mucho mayor de lo imaginado

McKinsey señalaba que los modelos, pipelines y datos asociados representan nuevas superficies de riesgo. El caso Lilli lo confirma: los prompts del sistema, almacenamiento de conversaciones y endpoints expuestos se convirtieron en vectores críticos de ataque.

2. Lo que antes tomaba semanas, ahora se compromete en minutos

Mientras McKinsey advertía que los incidentes tardan 73 días en contenerse, los atacantes autónomos ya pueden lograr compromisos totales en horas. El ataque a Lilli lo demostró: dos horas para un acceso completo.

3. Las herramientas de seguridad tradicionales se están quedando atrás

CodeWall identificó una vulnerabilidad que herramientas estándar o escáneres gratis como OWASP ZAP no detectaron. Esto confirma que los modelos de defensa actuales no están adaptados al ecosistema de IA.

4. La falta de preparación técnica para proteger IA es un riesgo sistémico

Lo sucedido con Lilli expone fallas profundas de seguridad en uno de los nombres más prestigiosos del sector. Esto muestra que la madurez de seguridad en IA es incluso más baja de lo que los expertos imaginaban.

Conclusiones: una llamada urgente para asegurar la IA corporativa

El ataque a Lilli no debe verse como un incidente aislado, sino como un indicio del futuro cercano:

- Los agentes ofensivos autónomos ya son una realidad.

- Las plataformas de IA corporativa presentan vectores de ataque nuevos y mal entendidos.

- Las herramientas de seguridad tradicionales no bastan.

- Las organizaciones deben elevar la seguridad de IA al mismo nivel que la seguridad de código y datos.

- Los grupos delictivos están empleando estas herramientas para ataques masivos, chantajes por fugas de datos y la difusión de ransomware.

- Los proveedores de ciberseguridad tienen una oportunidad —y responsabilidad— de reimaginar sus soluciones para un mundo con IA omnipresente.

McKinsey argumentaba que hacer la IA más segura es la próxima gran oportunidad para la industria. El incidente de Lilli demuestra que no solo es una oportunidad: es una necesidad urgente.

Para proteger las plataformas de IA corporativas, los expertos recomiendan un cambio fundamental: pasar de sistemas basados en la confianza a arquitecturas de defensa en profundidad que restrinjan matemáticamente lo que los agentes pueden hacer.

La teoría y la realidad se encontraron, y el resultado debe servir como impulso para que las organizaciones reevalúen, refuercen y reinventen la forma en que protegen sus sistemas de IA.

¿Está seguro que su aplicación web es segura?

Recibe un Diagnóstico Sin Costo del estado de seguridad de tu aplicación o sitio web dando clic en el siguiente enlace: