Ultimas noticias destacadas de seguridad informática

Segu-Info - Ciberseguridad desde 2000 Noticias de Ciberseguridad desde Segu-Info

- Disposición AR 1/2026 da 180 días a organismos públicos para reforzar su ciberseguridadpor SeguInfo en mayo 31, 2026 a las 1:17 pm

El Centro Nacional de Ciberseguridad argentino comunicó la Disposición 1/2026 con nuevos lineamientos técnicos para mejorar la resiliencia del Estado frente a ciberataques, fallas críticas e incidentes que puedan afectar servicios esenciales. Las claves del boletín oficial. La publicación en el Boletín Oficial de los nuevos lineamientos técnicos establecidos por el Centro Nacional de Ciberseguridad (CNC) para todos los organismos del sector estatal busca fortalecer la resiliencia cibernética de las infraestructuras críticas y mejorar las capacidades de prevención, respuesta y recuperación ante incidentes informáticos en organismos públicos. En concreto, establece un plazo de 180 días para que cada uno de los organismos implicados adecue sus infraestructuras, políticas y procedimientos internos a las nuevas disposiciones. La normativa representa un cambio de paradigma respecto de cómo los Estados abordan la seguridad digital: ya no alcanza con prevenir un ataque, sino que también resulta clave garantizar la continuidad operativa ante un incidente. El objetivo ya no es solo prevenir ataques, sino recuperarse rápido La nueva normativa pone el foco en la resiliencia y la recuperación operativa, en un contexto en el que durante años la mayoría de las estrategias defensivas se centraron en la prevención, pero el crecimiento y la evolución del ransomware y de otros tipos de ataques hizo que las organizaciones deban aceptar una realidad incómoda: ningún entorno es invulnerable. De acuerdo con la nueva normativa de la CNC, cada organismo deberá identificar y clasificar todos sus sistemas según el impacto que tendría su caída, tanto en lo económico, como en la afectación de servicios al ciudadano, las consecuencias legales y el daño reputacional. Para ello, se incorporan conceptos asociados a continuidad del negocio y recuperación ante desastres, como RTO (Recovery Time Objective) y RPO (Recovery Point Objective), que se utilizan para definir tiempos máximos de recuperación y pérdida aceptable de datos. En concreto, para sistemas de criticidad alta, el RTO deberá ser menor a 4 horas y la RPO no podrá superar una hora. En sistemas de criticidad media, el RTO será menor a 24 horas y el RPO menor a 4 horas. Mientras que, para los sistemas de criticidad baja, la recuperación podrá ubicarse entre 1 y 5 días, con copias de seguridad verificadas por muestreo. Centros de datos de respaldo y plan de recuperación de desastres Otro punto crítico es la obligación de contar con un Centro de Datos de Respaldo dentro del territorio argentino, para evitar que un mismo evento afecte en simultáneo al sitio principal y al alternativo (sea un ciberataque, un apagón masivo o desastre natural). Entre sus características, debe contar con niveles altos de disponibilidad, redundancia eléctrica y protección contra incendios, entre otros. Por otro lado, la nueva disposición obliga a los organismos estatales a efectuar una prueba anual de su Plan de Recuperación ante Desastres, pruebas de conmutación y pruebas de recuperación desde backups offline, entre otras. Se deben compartir las métricas dentro de un informe, para así llevar adelante un proceso operativo que cuente con evidencia, seguimiento y la oportunidad de una mejora continua. El texto de la norma incluso menciona escenarios específicos como ransomware y la caída total de infraestructura, exigiendo que existan guías paso a paso (playbooks) para llevar a cabo la recuperación en distintos escenarios de desastre. Estos playbooks deben ser específicos para cada tipo de incidente relevante, con el objetivo de minimizar el impacto operativo que pueda ocasionar un incidente de ciberseguridad. En este contexto, incorporar capacidades de Inteligencia de Amenazas resulta crítico, ya que permite a las entidades de gobierno “anticiparse mediante el análisis de actores, tácticas, técnicas y procedimientos (TTPs), priorizar riesgos en función del contexto geopolítico y sectorial, y transformar información en decisiones accionables para la protección de activos críticos. La resiliencia pasa al centro de la estrategia La nueva normativa refleja un cambio en la forma en que gobiernos y organizaciones a la cuestión de la ciberseguridad. Durante años, las organizaciones —tanto públicas como privadas— basaron sus estrategias bajo la premisa de impedir cualquier intrusión. Hoy, el paradigma comienza a cambiar: se asume que los incidentes pueden ocurrir y que, por lo tanto, las organizaciones deben estar preparadas para resistir, responder y recuperarse de la manera más rápida posible. En otras palabras, la resiliencia pasa a tener casi el mismo peso que la prevención. En el caso de los organismos estatales, esa capacidad de recuperación es crítica: no solo impacta sobre sistemas o infraestructuras, sino también sobre servicios esenciales, trámites, operaciones críticas y la vida cotidiana de los ciudadanos. Por eso, más allá del lado técnico de la normativa, la medida emerge como parte de una transformación mucho más amplia: la consolidación de la ciberseguridad como un componente central para la estabilidad y continuidad operativa de un país. Fuente: WeLiveSecurity

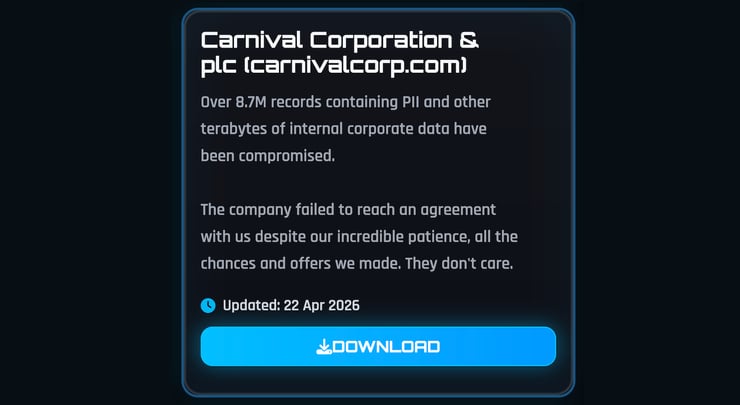

- Roban 6m registros del mayor operador de cruceros del mundo Carnivalpor SeguInfo en mayo 30, 2026 a las 1:16 pm

El mayor operador de cruceros del mundo, Carnival Corporation, ha confirmado oficialmente un exhaustivo incidente de ciberseguridad que ha comprometido la información personal de casi seis millones de clientes en todo el mundo. Según las declaraciones regulatorias presentadas ante las autoridades estatales, incluida la Oficina del Fiscal General de Maine, la brecha ha expuesto datos altamente sensibles pertenecientes a 5,995,277 personas. El gigante corporativo, que opera una enorme flota global a través de marcas emblemáticas como Carnival Cruise Line, Princess Cruises, Holland America Line y Seabourn, se encuentra actualmente trabajando contrarreloj para notificar a los pasajeros afectados y mitigar una oleada de riesgos secundarios de robo de identidad. El compromiso de seguridad comenzó presuntamente cuando un actor de amenazas digitales lanzó una campaña de ingeniería social altamente dirigida contra miembros del personal de Carnival. El 14 de abril, una sola cuenta de empleado fue manipulada con éxito, lo que permitió al adversario externo eludir las defensas perimetrales y establecer un punto de apoyo digital dentro de un segmento restringido de los sistemas informáticos internos de la empresa. Para el 22 de abril, los investigadores descubrieron que el atacante había logrado exfiltrar y copiar de forma agresiva enormes volúmenes de archivos corporativos antes de que los equipos de seguridad pudieran cortar por completo el acceso no autorizado. Aunque el conglomerado de vacaciones no nombró explícitamente a los cibercriminales detrás de la intrusión en la red, el conocido sindicato de extorsión conocido como ShinyHunters se atribuyó públicamente la responsabilidad del ciberataque. Posteriormente, el grupo publicó un enorme conjunto de datos que contenía aproximadamente 8.7 millones de registros en su repositorio de la dark web, después de que un aparente intento de extorsión no lograra obtener un pago corporativo. Un análisis forense de la base de datos filtrada indica que la asombrosa cifra de 7.5 millones de cuentas pertenecían específicamente al programa de recompensas por fidelidad Mariner Society, operado por Holland America Line, lo que demuestra que los delincuentes recolectaron intensamente documentación de viajeros frecuentes. Los puntos de datos específicos robados por el grupo de extorsión digital varían según el pasajero, pero el alcance de la documentación comprometida resulta profundamente preocupante para los analistas de riesgo corporativo. En comunicados corporativos y avisos sustitutivos, Carnival confirmó que los archivos robados contienen información de identificación personal (PII) exhaustiva, que incluye nombres completos de clientes, direcciones físicas residenciales, números de teléfono de contacto y direcciones de correo electrónico. Lo que es más alarmante, los actores de amenazas descargaron con éxito archivos que contenían fechas de nacimiento, números internos de seguimiento de programas de fidelidad y documentos críticos de identificación emitida por el gobierno, incluidos detalles de licencias de conducir y números de pasaporte. El servicio de notificación de filtraciones de datos Have I Been Pwned analizó los datos filtrados por la banda de extorsionadores y afirmó que la filtración expuso los nombres, fechas de nacimiento, direcciones de correo electrónico, géneros, ubicaciones geográficas y detalles del programa de fidelización de las personas afectadas. Inmediatamente después de descubrirse la filtración, la unidad de respuesta a incidentes empresariales de Carnival se movilizó junto con expertos en ciberseguridad externos para expulsar a los actores de amenazas del entorno y evaluar la totalidad de los daños operativos. La compañía de cruceros ha declarado que desde entonces ha implementado controles de monitoreo mejorados y ha reforzado sus protocolos de autenticación para protegerse contra futuros exploits de infraestructura centrados en el factor humano. A partir de finales de mayo, la corporación inició una campaña masiva de notificación electrónica para informar formalmente a los viajeros afectados sobre la exposición de sus credenciales y delinear protocolos de remediación de protección. Para proteger a los viajeros comprometidos de campañas de phishing dirigidas y el posterior fraude financiero, Carnival está proporcionando a las personas afectadas una suscripción gratuita de 24 meses a la plataforma de resolución de fraudes y monitoreo de crédito MyTrueIdentity de TransUnion. Los analistas independientes de ciberseguridad advierten que las filtraciones de datos en la industria de viajes son excepcionalmente peligrosas debido a que los actores de amenazas pueden utilizar historiales de viaje explícitos, clasificaciones de fidelidad y detalles de pasaportes para diseñar señuelos engañosos hiperrealistas. En el futuro, se espera que los reguladores de múltiples jurisdicciones examinen de cerca las prácticas de retención de datos de la línea de cruceros y los fallos previos de seguridad en su infraestructura, especialmente dados los antecedentes de Carnival con incidentes de seguridad de datos anteriores. Fuente: BC

- Campañas de malware Grandoreiro y BTMOB RAT atacan a usuarios de Windows y Android en América Latinapor SeguInfo en mayo 29, 2026 a las 1:17 pm

Latinoamérica y Europa se han convertido en el objetivo de dos campañas de troyanos bancarios diseñadas para infectar dispositivos Windows y Android con el malware Grandoreiro y BTMOB, respectivamente. Esto se desprende de nuevos hallazgos de WatchGuard y ESET, que han observado el uso de estas dos familias de malware para atacar a empresas en España, Portugal y México, así como a usuarios de móviles en Brasil. Telefónica Tech también ha publicado un análisis técnico sobre las campañas recientes de Grandoreiro. El documento completo, disponible para descarga, detalla la cadena de infección del malware, sus mecanismos de evasión y las técnicas para mantener la comunicación con su infraestructura de mando y control. La campaña Grandoreiro "utiliza la técnica de carga lateral de DLL, abusando de cuatro programas diferentes y apuntando a bancos en Portugal", afirmó Euler Neto, investigador de WatchGuard. Activo desde 2016, Grandoreiro es un malware bancario en constante evolución capaz de robar credenciales de miles de instituciones financieras en 45 países y territorios. Generalmente se distribuye mediante correos electrónicos de phishing, incitando a los destinatarios a hacer clic en enlaces sospechosos. A pesar de algunas detenciones e intentos de las autoridades brasileñas por desmantelar su infraestructura a principios de 2024, el malware ha seguido expandiendo su alcance, incorporando comprobaciones CAPTCHA para resistir el análisis. La última campaña detectada por WatchGuard utiliza la carga lateral de DLL para ejecutar archivos desarrollados en Delphi 11, un lenguaje de programación comúnmente empleado por malware dirigido a la región. Dos de estas DLL —mingwm10.dll y libwebp.dll— incorporan sgcWebSockets, una biblioteca de WebSocket y comunicación en tiempo real, para comunicaciones punto a punto (P2P) y WebRTC. "Las DLL asociadas a este caso utilizan el protocolo STUN (Session Traversal Utilities for NAT), que permite a los dispositivos detrás de un NAT descubrir su dirección IP pública y número de puerto, posibilitando la comunicación punto a punto", explicó WatchGuard. "La ventaja para los ciberdelincuentes de utilizar el tráfico de videoconferencias en sus campañas radica en que este tráfico es ruidoso, difícil de monitorizar y en que WebRTC se utiliza habitualmente en las principales plataformas de videoconferencias". Otras dos DLL asociadas a la campaña son libffi-6.dll y libpng15.dll, que utilizan el protocolo ICE (Interactive Connectivity Establishment) en lugar de STUN para lograr el mismo objetivo. Estos archivos hacen referencia específica a bancos e instituciones financieras que operan en Portugal, como Abanca, Banco de Portugal, BBVA PT, Caixa Geral Depósitos y Santander, entre otros. También se ha atacado a Revolut y Wise. WatchGuard también informó haber identificado otra campaña en la que se utilizan correos electrónicos de phishing para distribuir un archivo ZIP alojado en Mediafire. El archivo contiene un script de Visual Basic ofuscado que ejecuta un archivo ejecutable, el cual muestra un mensaje solicitando a los usuarios que actualicen Adobe Reader haciendo clic en un botón integrado en la alerta. Al hacerlo, se activa una serie de comprobaciones destinadas a evitar la detección y dificultar el análisis del malware, antes de ejecutar la carga útil final para robar información bancaria y datos confidenciales. Algunas de las tácticas coinciden con una campaña anterior de Grandoreiro detallada por Kaspersky en octubre de 2024. "Lo más relevante aquí no es solo que Grandoreiro siga activo", afirmó WatchGuard. "Es que los grupos de ciberdelincuentes con fines lucrativos continúan adaptándose rápidamente, reutilizando servicios legítimos y ocultándose en patrones de tráfico en los que muchas organizaciones ya confían". "Al combinar phishing, carga lateral de DLL, componentes relacionados con WebRTC, abuso de servicios en la nube y comprobaciones anti-análisis, estas campañas demuestran cómo el malware bancario se está volviendo más difícil de detectar con defensas superficiales únicamente". BTMOB ofrece herramientas de campaña listas para usar La revelación coincide con un informe de ESET sobre BTMOB, un troyano de acceso remoto (RAT) para Android que surgió en febrero de 2025 con la capacidad de desbloquear dispositivos, capturar capturas de pantalla, registrar pulsaciones de teclas, automatizar el robo de credenciales mediante inyecciones HTML al abrir ciertas aplicaciones y habilitar el control remoto. Una versión posterior introdujo la capacidad de capturar PIN de Alipay. "El RAT también se vende con una interfaz para crear APK, lo que permite a cualquiera generar nuevas cargas útiles y adaptar señuelos de phishing para regiones específicas con rapidez, y sin escribir código", afirmó Daniel Cunha Barbosa, investigador de ESET. Las campañas de BTMOB se han observado principalmente en ataques en Brasil y Latinoamérica, pero la distribución basada en phishing y las capacidades de toma de control de dispositivos del malware, junto con las herramientas listas para usar para crear aplicaciones, lo convierten en una amenaza potente que plantea riesgos mucho más allá de la región y reduce el tiempo y el esfuerzo necesarios para comprometer completamente un dispositivo, advirtió la empresa de seguridad eslovaca. El principal método de propagación del malware es la ingeniería social, mediante la cual se envían a los usuarios enlaces a sitios web falsos que se hacen pasar por servicios de streaming, plataformas de minería de criptomonedas y otros servicios en línea de confianza. Desde esos sitios, las víctimas son redirigidas a fichas falsas de aplicaciones en Google Play Store que las engañan para instalar un archivo APK de Android que contiene el malware. Una vez instalado, el malware solicita permisos para usar los servicios de accesibilidad de Android y luego los aprovecha para obtener acceso adicional al sistema sin ninguna interacción del usuario. Se cree que BTMOB es el sucesor de las familias CraxsRAT, CypherRAT y SpySolr. A mayo de 2026, la última versión del malware (BTMOB v4.5.5) afirmaba ofrecer protección APK mejorada y compatibilidad con las últimas actualizaciones de Google Play. "Esta actualización se centra en la velocidad y la estabilidad", publicó un perfil X supuestamente vinculado al malware el 1 de mayo de 2026. "Hemos ampliado nuestra infraestructura y perfeccionado el generador para que siempre tengas acceso a los últimos parches de seguridad móvil". El troyano es promocionado por un actor malicioso llamado EVLF (@craxso) a un precio de 700 dólares al mes. Según un vídeo de YouTube compartido por el autor del malware el 1 de mayo de 2026, una licencia de por vida cuesta 1200 dólares. El código fuente completo del servidor está disponible por 7000 dólares, lo que permite a los clientes alojar los paneles de comando y control (C2) en su propia infraestructura. Esta misma semana, el perfil X también compartió un enlace a un artículo de Medium sobre "cómo el troyano BTMOB RAT está convirtiendo los teléfonos Android en armas teledirigidas" y cómo ha estado "evolucionando rápidamente" desde principios de 2025. "Se infiltra a través de sitios de phishing, se apodera de los servicios de accesibilidad y convierte tu teléfono en una marioneta", dice el artículo. "Los hackers vigilan tu pantalla en tiempo real. Roban datos bancarios. Incluso minan criptomonedas en segundo plano mientras navegas por Instagram". Curiosamente, el artículo fue publicado por una cuenta llamada "Desarrollador principal de CraxsRAT". La biografía de la cuenta afirma que se trata de un "ciberdelincuente hábil e ingenioso que creó una lucrativa empresa de ciberdelincuencia vendiendo malware RAT altamente avanzado a otros actores maliciosos". El hecho de que BTMOB se venda bajo un modelo de malware como servicio (MaaS) conlleva el riesgo de facilitar el acceso a actores maliciosos menos sofisticados. Esto se ve agravado por informes que indican que ya circulan versiones filtradas en foros clandestinos y Telegram, lo que aumenta el riesgo de abuso por parte de imitadores y otros aspirantes a delincuentes. "El acceso rara vez se mantiene restringido indefinidamente, y la herramienta puede llegar a mercados secundarios mediante la reventa, el trueque o el intercambio dentro de grupos cerrados", declaró ESET. "Otras familias de malware también pueden copiar algunos elementos que facilitan la personalización de la carga útil y la gestión de campañas para delincuentes menos experimentados". La empresa italiana de ciberseguridad D3Lab, en un análisis del kit de desarrollo del troyano de acceso remoto BTMOB, filtrado y publicado en diciembre de 2025, afirmó que incluía el código fuente de la carga útil para Android, su instalador, un entorno de compilación, el panel de control para Windows, el servidor C2 y todas las dependencias de software necesarias para desplegar la plataforma. "La filtración de BTMOB ofrece una perspectiva única sobre el funcionamiento interno de un ecosistema moderno de troyano de acceso remoto como servicio para Android", señaló D3Lab en aquel momento. "Demuestra que el atacante no opera simplemente como un desarrollador que vende un kit de herramientas, sino como un proveedor de servicios que impone licencias, autenticación y control de versiones a sus clientes". Fuente: THN

- Explotan una vulnerabilidad de FortiClient EMS para distribuir malware (CVE-2026-35616)por SeguInfo en mayo 28, 2026 a las 10:25 pm

Los delincuentes están explotando una vulnerabilidad de omisión de autenticación (CVE-2026-35616) en FortiClient Enterprise Management Server (EMS) para distribuir un programa de robo de credenciales no documentado llamado EKZ. El atacante disfrazó el malware como una actualización para los endpoints de Fortinet y lo ejecutó mediante flujos de trabajo de scripts VPN gestionados por FortiClient. La vulnerabilidad crítica explotada es un fallo de control de acceso inadecuado que permite a atacantes remotos no autenticados ejecutar código o comandos arbitrarios mediante solicitudes especialmente diseñadas. A principios de abril, Fortinet confirmó que estaba siendo explotado y publicó parches de emergencia para las versiones 7.4.5 y 7.4.6 del producto. A principios de este mes, la empresa de ciberseguridad Arctic Wolf detectó ataques que aprovechaban esta vulnerabilidad para distribuir el programa de robo de información EKZ. Los investigadores señalan que la intrusión comienza con el abuso de las API de los endpoints para realizar acciones administrativas sin autenticación. Posteriormente, el atacante modifica la configuración de EMS y las políticas de VPN para ejecutar scripts maliciosos. Segundos después de que los endpoints establecieran un túnel IPsec con un firewall FortiGate, el archivo legítimo fortitray.exe ejecuta scripts maliciosos a través del símbolo del sistema. Estos scripts ejecutan una carga útil de PowerShell codificada en Base64 que descarga y ejecuta malware disfrazado de parche de Fortinet, para luego extraer datos a un VPS controlado por el atacante mediante HTTP. "En lugar de utilizar un señuelo de malware genérico, la carga útil se presentó como una actualización de Fortinet y se ejecutó mediante flujos de trabajo de scripting VPN gestionados por FortiClient", indica el informe de Arctic Wolf. "En los puntos finales afectados, los componentes de FortiClient ejecutaron scripts de comandos que invocaron PowerShell, descargaron un programa para robar credenciales, lo ejecutaron silenciosamente y extrajeron los datos del navegador antes de eliminar los archivos locales". La carga útil descargada, identificada como EKZ Infostealer, presenta una funcionalidad de robo de información bastante estándar. Ataca tanto navegadores web basados en Chromium como Firefox y extrae los datos almacenados en archivos de texto, eludiendo las protecciones de contraseña cifrada. El malware ataca credenciales, datos de tarjetas de crédito, direcciones, números de teléfono y cookies, lo que permite acceder a cuentas protegidas por autenticación multifactor sin iniciar sesión. Según Arctic Wolf, un indicio de un intento de explotación en ataques que distribuyen el infostealer EKZ es la presencia en los registros de la línea "Certificate not found in request header". En pruebas de laboratorio, este error fue seguido, segundos después, por otra entrada: "Certificate user: fortinet-ca2 … successfully updated". Por lo tanto, los investigadores recomiendan que los responsables de seguridad busquen anomalías en la autenticación de certificados y cambios inesperados en las configuraciones del perfil de acceso remoto. Cualquier actividad administrativa sospechosa, como nuevas cuentas, inicios de sesión con un origen desconocido (Tor, direcciones IP de VPS) o acciones que provoquen cambios de configuración, debe considerarse una señal de alerta. El informe de Arctic Wolf proporciona una guía de detección exhaustiva que podría ayudar a las organizaciones a prevenir los ataques observados. Fuente: BC

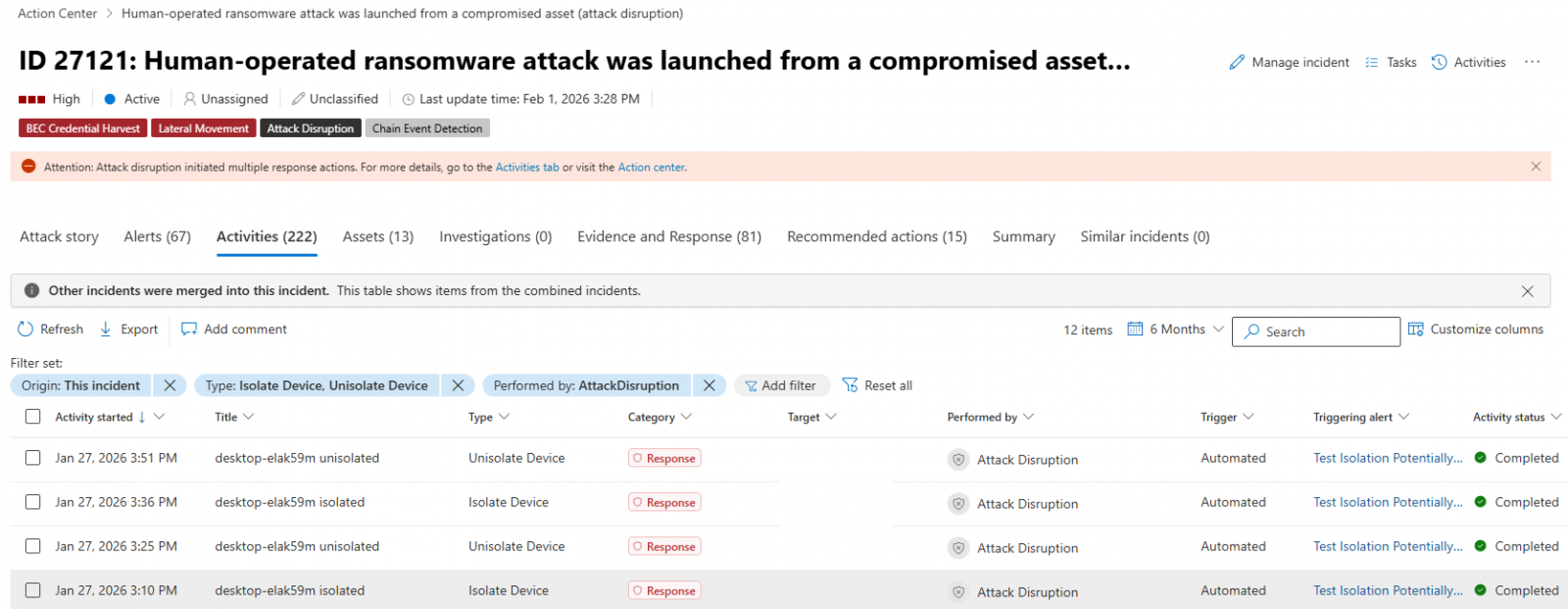

- Microsoft Defender aisla automáticamente los endpoints infectadospor SeguInfo en mayo 27, 2026 a las 2:49 pm

Microsoft está probando una nueva función de Defender for Endpoint que aislará automáticamente los dispositivos comprometidos para frustrar los intentos de los atacantes de propagarse lateralmente por la red. Esta función ya está disponible en versión preliminar y forma parte de la interrupción automática de ataques, una característica diseñada para contener los ataques, limitar su impacto y brindar a los equipos de seguridad más tiempo para solucionarlos. Los dispositivos comprometidos que se aíslan automáticamente se desconectan de la red para reducir el riesgo de un mayor impacto, pero mantienen la conectividad con el servicio Microsoft Defender for Endpoint, que seguirá supervisando el dispositivo. "Cuando se sospecha que un dispositivo de su organización está comprometido, Microsoft Defender for Endpoint puede aislarlo automáticamente como parte de la interrupción automática de ataques", declaró Microsoft. El aislamiento automático ayuda a reducir el riesgo de un mayor impacto en la organización, limita el movimiento lateral del atacante y previene impactos como la exfiltración de datos y la propagación de ransomware. El aislamiento automático de dispositivos solo funciona en estaciones de trabajo de usuarios finales incorporadas y administradas por Microsoft Defender for Endpoint. Como explicó Microsoft, los operadores de seguridad también pueden liberarlas del aislamiento en cualquier momento después de completar la investigación del incidente y mitigar los riesgos. Para liberar un dispositivo del aislamiento automático, selecciónelo en el "Inventario de dispositivos" o abra la página del dispositivo y seleccione "Liberar del aislamiento" en el menú de acciones. Hace casi cuatro años, en junio de 2022, Microsoft también anunció que los administradores podían aislar manualmente los dispositivos Windows comprometidos y no administrados interrumpiendo la comunicación entrante y saliente con los puntos finales incorporados a Defender for Endpoint. Microsoft también comenzó a probar la compatibilidad con el aislamiento de dispositivos para Defender for Endpoint en dispositivos Linux integrados en enero de 2023, y esta funcionalidad estuvo disponible para el público general en octubre de 2023. Ese mismo mes, reveló que Defender for Endpoint también podía aislar las cuentas de usuario comprometidas como parte de la interrupción automática de ataques para bloquear el movimiento lateral en ataques de ransomware que utilizan el teclado. Más recientemente, Microsoft comenzó a probar otra nueva función para la plataforma de seguridad empresarial Defender for Endpoint que bloquea automáticamente el tráfico hacia y desde terminales Windows no detectados, impidiendo que los atacantes accedan a otros dispositivos no comprometidos en la red. A principios de este mes, reveló otra función de vista previa de Defender for Endpoint que permitirá a los administradores programar análisis antivirus en sistemas Linux incorporados mediante el portal de Microsoft Defender, la configuración JSON administrada por mdatp o la herramienta de línea de comandos mdatp. "Los análisis programados admiten análisis rápidos diarios, análisis rápidos basados en intervalos y análisis completos semanales, con opciones para ejecución de baja prioridad, programación en tiempo de inactividad y horarios de inicio aleatorios", indicó. Fuente: BC

WeLiveSecurity WeLiveSecurity

- Qué tener en cuenta antes de pedirle consejo de salud a un chatbot de IAen mayo 29, 2026 a las 5:43 pm

Usar chatbots de IA para consultas de salud implica riesgos que van desde errores en las respuestas hasta problemas de privacidad y seguridad de los datos.

- Reporte de Actividad APT del cuarto trimestre de 2025 al primero de 2026en mayo 28, 2026 a las 2:55 pm

Una visión general de las actividades de los grupos APT seleccionados investigados y analizados por ESET Research en el cuarto trimestre de 2025 y el primer trimestre de 2026

- Argentina da 180 días a organismos públicos para reforzar su ciberseguridaden mayo 20, 2026 a las 8:04 pm

El Centro Nacional de Ciberseguridad argentino comunicó nuevos lineamientos técnicos para mejorar la resiliencia del Estado frente a ciberataques, fallas críticas e incidentes que puedan afectar servicios esenciales. Las claves del boletín oficial.

- Webworm: el grupo APT evoluciona sus tácticas y se apoya en plataformas legítimasen mayo 20, 2026 a las 1:02 pm

El equipo de investigación de ESET analizó al grupo de ciberespionaje utiliza servicios cotidianos como GitHub, Discord y la API de Microsoft Graph para alojar malware y gestionar sus comunicaciones de comando y control (C&C).

- EvilTokens: la campaña de phishing obtiene accesos abusando de un mecanismo legítimoen mayo 19, 2026 a las 6:32 pm

¿Qué sucede cuando un ataque utiliza infraestructura oficial en vez de falsificarla? EvilTokens marca una evolución en el phishing: ya no captura credenciales, sino que induce a las víctimas a autorizar sesiones legítimas.

.jpg)